Por Gerardo Abraham

“Quien renuncia a su libertad por seguridad, no merece ni libertad ni seguridad” (Benjamin Franklin)

El Sistema de Reconocimiento Facial de Prófugos (SRFP) que utiliza el Gobierno de la Ciudad de Buenos Aires desde mayo de 2019 es inconstitucional, según un fallo de Elena Liberatori, del Juzgado en lo Contencioso, Administrativo y Tributario 14. La jueza consideró que el sistema informático se puso en funcionamiento sin cumplir con los parámetros legales de protección de datos personales de las y los ciudadanos porteños. El fallo hizo lugar al amparo presentado a fines de 2020 por el Observatorio de Derecho Informático Argentina (ODIA).

“Si uno agarra la Constitución Nacional en el artículo 19 está todo”, cuenta Rodrigo Iglesias, apoderado legal de ODIA. “Hay un momento donde tenés todo el derecho de estar solo con vos mismo y que te sea respetado y cumplido y que no esté bajo el control de los magistrados. Si me vulneran mi privacidad e intimidad, vulneran un derecho muy simple que es el derecho a la confidencialidad, por ejemplo entre abogado y cliente, o entre el periodista con su fuente.”

Cuando una persona circula por la calle y es captada por distintas cámaras, se vulnera su derecho a la imagen, a su privacidad. Esos datos que están siendo captados también puede ser susceptibles de venderse, comercializarse, distribuirse o que alimenten una base de datos que reconozca otros rostros en otro país. “Hicimos el pedido de acceso a la información pública en el año 2019 y el propio Gobierno de la Ciudad no nos contestó ganando en dos instancias”, cuenta Iglesias.

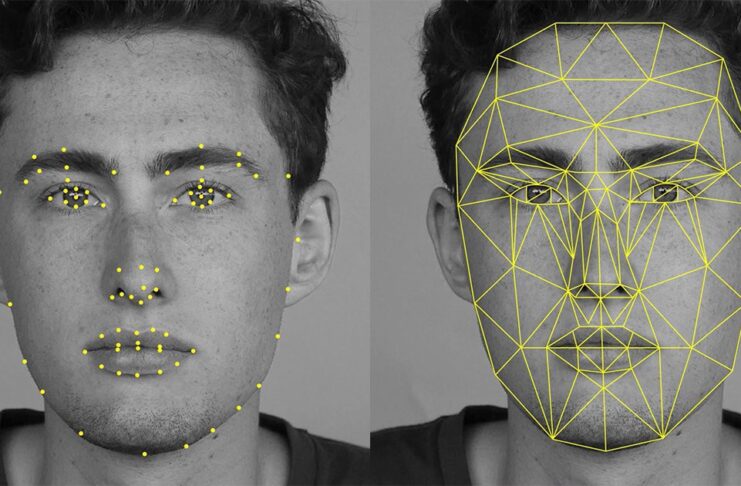

El GCBA desplegó 9.500 cámaras de seguridad, equipadas con un software de reconocimiento facial, a lo largo y ancho de la ciudad. Lo filmado se envía al Centro de Monitoreo Urbano, supervisado por el Ministerio de Seguridad y Justicia. El sistema se implementó con el objetivo de detectar a personas buscadas por la policía, y estaba regido por un convenio de cooperación entre el Ministerio de Seguridad de Buenos Aires y el Registro Nacional de las Personas (Renaper), y permitía acceder a una base de datos de aproximadamente 40 mil ciudadanos y ciudadanas.

El SNRP es como una caja negra que no se sabe cómo funciona, ni si se están regalando los datos de la ciudadanía, ni si se utilizan para otra cosa. “Hoy la Ley de Acceso a la Información Pública, en su artículo 8c, tiene cuestiones de propiedad intelectual que debe cumplir y por eso no contestan algunas cosas, como por ejemplo el código fuente”, aclara el apoderado del observatorio. Todas las personas que circulan por la CABA son “culpables” hasta que el algoritmo no “te matchea” con la base de datos con la que se entrenó al algoritmo. Estos sistemas tienen muchos errores y el gobierno porteño admite una tasa del 53 por ciento. “Uno de cada dos matcheos está mal”, aclara Iglesias.

Por su lado, Ariel Garbarz, ingeniero en Telecomunicaciones y profesor de la UTN, UBA y UNLA, asegura que “usar de forma masiva un sistema de reconocimiento facial, en todos lados, en cualquier espacio público, para lo único que sirve es para alimentar la Big Data”. Además de buscar e identificar personas, estos sistemas guardan los lugares, las zonas que suelen frecuentar, las personas con las que se encuentran y hasta establecen patrones de conducta. Datos que el día de mañana podrían ser usados para la persecución política. “No existe una ley específica que obligue a que esos datos biométricos caigan dentro de la Ley de Protección de los Datos Personales”, explica Garbarz.

En la pericia informática que se hizo sobre el SNRP, en un allanamiento en marzo de este año al Ministerio de Seguridad y Justicia de la CABA, a cargo de Marcelo D’Alessandro, se detectó que hay por lo menos 15 mil personas, con sus datos biométricos incluidos, siendo buscadas por un sistema en el que no deberían estar porque “no son prófugas, ni siquiera estuvieron prófugas algunas vez, ni siquiera tienen proceso judicial, ni están detenidas”, además de que los falsos positivos siguen dentro del sistema. “Si hoy se encendiera, ese sistema estaría buscando gente que no tendría que estar, de hecho no están ni estuvieron nunca en la base de la Consulta Nacional de Rebeldías y Capturas (Conarc), incluso también estoy en esa lista y nunca tuve una causa judicial”, cuenta Iglesias.

“Cuando en una sociedad aumenta la inseguridad, se generan las condiciones para que los regímenes autoritarios, especialmente los de derecha y ultraderecha, aprovechen o instrumenten incluso la propia inseguridad, para implementar sistemas de videovigilancia para espiarnos con un único objetivo: el control social”, explica Ariel Garbarz.

Edición: Candela Contreras y Sofía Barragán